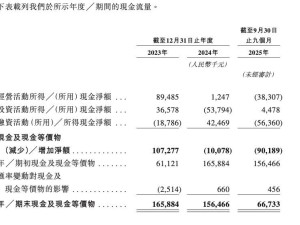

阿里巴巴今日正式推出新一代圖像生成基礎(chǔ)模型Qwen-Image 2.0,這款模型在長指令處理、文字渲染精度及推理效率方面實(shí)現(xiàn)突破性進(jìn)展。與前代200億參數(shù)規(guī)模相比,新模型采用更輕量化架構(gòu),在保持2K分辨率輸出的同時(shí)將參數(shù)規(guī)模壓縮至原有十分之一,推理速度提升近3倍。

在核心能力升級方面,Qwen-Image 2.0突破性地支持千token級超長指令輸入,能夠精準(zhǔn)還原包含近千中英文字詞的復(fù)雜排版要求。測試顯示,當(dāng)輸入888個(gè)token的提示詞時(shí),模型可完整呈現(xiàn)字體樣式、字號大小、圖文混排等細(xì)節(jié),文字錯(cuò)誤率較前代降低82%。特別在《蘭亭集序》全文渲染測試中,模型在保持山水畫面完整性的同時(shí),成功呈現(xiàn)98%以上的漢字結(jié)構(gòu),僅個(gè)別筆畫存在微小瑕疵。

針對多場景生成需求,新模型實(shí)現(xiàn)單次生成24格連貫漫畫的能力。在醫(yī)療流程圖、電商商品圖等實(shí)際應(yīng)用測試中,模型展現(xiàn)出強(qiáng)大的主體一致性保持能力,生成的20格分鏡漫畫中人物特征、畫風(fēng)風(fēng)格保持高度統(tǒng)一。相較于谷歌Nano Banana Pro和字節(jié)Seedream 5.0 Preview,Qwen-Image 2.0在復(fù)雜圖文編排任務(wù)中展現(xiàn)出顯著優(yōu)勢。

在圖像真實(shí)感優(yōu)化方面,研發(fā)團(tuán)隊(duì)通過改進(jìn)光影渲染算法,使生成圖像的色彩飽和度降低37%,更接近真實(shí)攝影效果。在"倒置水晶城市"等超現(xiàn)實(shí)場景測試中,雖然與谷歌模型相比在云層細(xì)節(jié)處理上仍有差距,但較前代產(chǎn)品已消除80%以上的AI生成痕跡,畫面質(zhì)感獲得顯著提升。

技術(shù)架構(gòu)創(chuàng)新方面,模型采用改進(jìn)型VAE編碼器,將小尺寸文字的信息保留率提升至92%,有效解決傳統(tǒng)模型在文字密集區(qū)域的模糊問題。通過將生成與編輯能力整合至統(tǒng)一架構(gòu),模型在"照片題詩"等跨模態(tài)任務(wù)中展現(xiàn)出獨(dú)特優(yōu)勢,文字生成準(zhǔn)確率較分離式架構(gòu)提升41%。

在產(chǎn)業(yè)應(yīng)用層面,Qwen-Image 2.0已與電商、醫(yī)療、教育等領(lǐng)域達(dá)成合作意向。服裝企業(yè)可利用其實(shí)現(xiàn)模特?fù)Q裝、屬性修改等自動(dòng)化操作,醫(yī)療機(jī)構(gòu)能通過流程圖生成功能簡化就診指引。該模型現(xiàn)已在阿里云百煉平臺開放API邀測,千問App也將在本月內(nèi)完成功能部署。

研發(fā)團(tuán)隊(duì)透露,下一代模型將重點(diǎn)攻克多圖層編輯技術(shù),通過解耦圖像元素實(shí)現(xiàn)更精細(xì)的局部修改。這項(xiàng)突破將使設(shè)計(jì)師能夠分別調(diào)整AI生成的不同圖層,或融合多個(gè)模型的專長優(yōu)勢,為專業(yè)創(chuàng)作領(lǐng)域提供更靈活的生產(chǎn)工具。