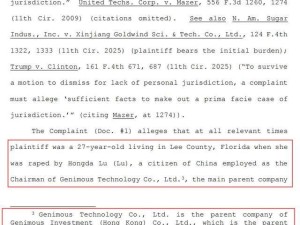

英偉達近日宣布,其NVIDIA Blackwell平臺已完成對DeepSeek-V4-Pro與DeepSeek-V4-Flash兩款大模型的適配工作。開發者可通過NVIDIA NIM微服務直接下載部署,或基于SGLang、vLLM框架實現定制化推理,為AI應用開發提供更靈活的技術路徑。

在模型參數配置上,DeepSeek-V4-Pro以1.6萬億總參數量與490億激活參數的組合,專注于復雜推理場景;而DeepSeek-V4-Flash則采用2840億總參數量與130億激活參數的輕量化設計,主打高速響應需求。兩款模型均支持百萬級Token上下文窗口與最高38.4萬Token的輸出能力,可覆蓋長文檔分析、代碼生成等核心應用場景,并采用MIT開源協議保障技術共享。

性能測試顯示,DeepSeek-V4-Pro在NVIDIA GB200 NVL72集群上實現每用戶每秒150個token的基準性能,通過vLLM框架的Day 0優化方案,可在Blackwell B300架構上快速完成部署。隨著Dynamo編譯器、NVFP4量化技術及CUDA內核的持續優化,模型推理效率有望進一步提升。

在部署生態構建方面,SGLang框架提供低延遲、均衡負載及最大吞吐量三種優化模式,滿足不同場景的性能需求;vLLM框架則支持跨100個以上GPU節點的分布式推理,并集成工具調用與推測解碼功能,為大規模AI服務提供技術支撐。這種多框架兼容的設計,顯著降低了開發者將模型落地至生產環境的門檻。